El mundo tal como lo conocemos ha sido moldeado por la evolución de la tecnología. Entre los hitos de esta saga se encuentra la creación del ENIAC (Electronic Numerical Integrator and Computer), reconocido como el primer ordenador digital programable. Desarrollado durante la febril era de la Segunda Guerra Mundial, ENIAC sentó las bases para la revolución informática moderna.

El nacimiento de un gigante: un panorama histórico

La necesidad nacida de la guerra

Durante la Segunda Guerra Mundial, Estados Unidos se enfrentó a una tarea insuperable: calcular las tablas de disparo de artillería con rapidez y precisión. Para solucionar este problema, el ejército estadounidense contrató a la Universidad de Pensilvania para que desarrollara una máquina que pudiera realizar el trabajo con tenacidad. Así nació el proyecto ENIAC.

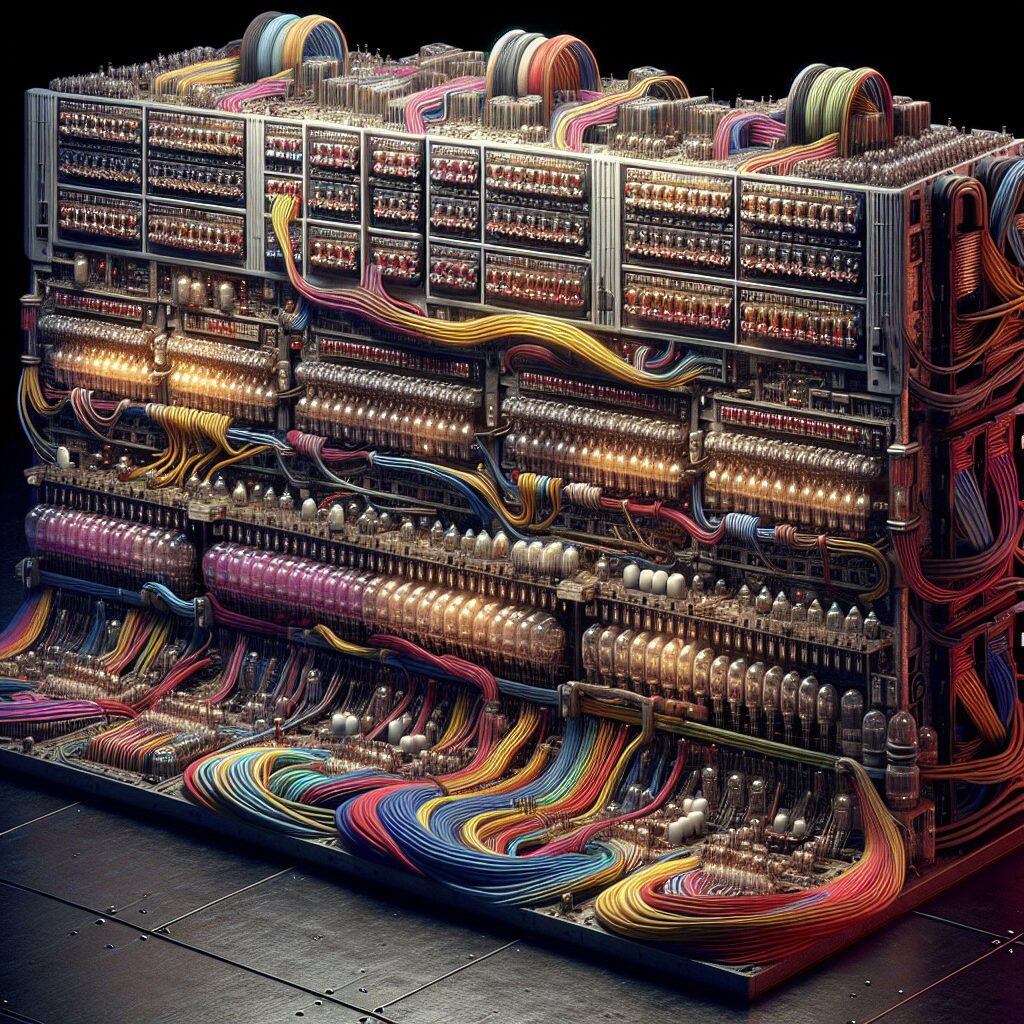

ENNAC fue diseñado por John Mauchly y J. Presper Eckert y entró en funcionamiento en 1945. Con más de 17.000 tubos de vacío y un consumo de 150 kilovatios de electricidad, ENIAC era un gigante en tamaño y potencia. A pesar de esto, presagiaba una nueva era en la informática.

La maravilla técnica de su época

Comprender la arquitectura de ENIAC

ENIAC fue diseñado para ser reprogramable para resolver una amplia variedad de problemas informáticos, un salto significativo con respecto a sus predecesores. Su arquitectura se extendía por más de 1.800 pies cuadrados y albergaba 40 paneles que realizaban numerosos cálculos simultáneamente. Para programarlo, habría que configurar manualmente miles de cables e interruptores, tareas que las computadoras modernas realizan con código binario.

La computadora era capaz de realizar cálculos a una velocidad 1.000 veces más rápida que la de cualquier dispositivo informático existente en su época, lo que demuestra una potencia de procesamiento sin precedentes.

Legado e influencia

Allanando el camino hacia las computadoras modernas

ENIAC revolucionó la informática. Sus principios allanaron el camino para futuros avances informáticos. Demostró que los cálculos complejos podían automatizarse, lo que condujo al desarrollo y proliferación de computadoras digitales programables. Puede leer más sobre el impacto de ENIAC en Wikipedia.

Invenciones posteriores, como UNIVAC I, el sucesor comercial de ENIAC, capitalizaron aún más sus principios de diseño.

Implicaciones prácticas en el mundo actual

¿Sabías?

Muchas tecnologías modernas tienen su origen en las innovaciones inspiradas por ENIAC. Los principios del procesamiento automatizado se pueden ver en todo, desde teléfonos inteligentes personales hasta servidores de redes globales.

La influencia de ENIAC se extiende a los ámbitos de la investigación científica, la banca e incluso el entretenimiento, sustentando los complejos algoritmos que gobiernan los mercados financieros y la inteligencia artificial que orquesta los gráficos de los juegos actuales.

El Canal Historia ofrece más lecturas sobre cómo ENIAC allanó el camino para la informática moderna.

Conclusión: un legado que trasciende el tiempo

El ENIAC era más que un simple conjunto de cables y tubos; era una visión del futuro de la informática. A medida que la tecnología continúa creciendo a un ritmo exponencial, reflexionar sobre el legado de ENIAC nos recuerda la curiosidad y el ingenio ilimitados de la humanidad.